El filósofo artificial y la hipnocracia: ¿Experimento social o estrategia de marketing?

Lo que según diferentes medios de comunicación se trataría de un “aclamado filósofo" en realidad era un experimento social que usó ChatGPT.

El filósofo artificial y la hipnocracia: ¿Experimento social o estrategia de marketing?

La historia que se repite globalmente sitúa el origen de esta noticia en una mesa redonda del 14 de febrero de 2025, en Cannes, Francia. Esta contó con la participación de diversos expertos y expertas en materia de inteligencia artificial, gobernanza y política.

El evento ocurrió, así lo confirmó Congreso Futuro con una de sus participantes, la investigadora del Instituto de Estudios Europeos y Derechos Humanos Cecilia Danesi, que según relata, entre los distintos temas que abordaron, “el disparador del debate del panel fue este libro, no se habló del autor, sino del contenido que se propone en el libro de la hipnocracia”.

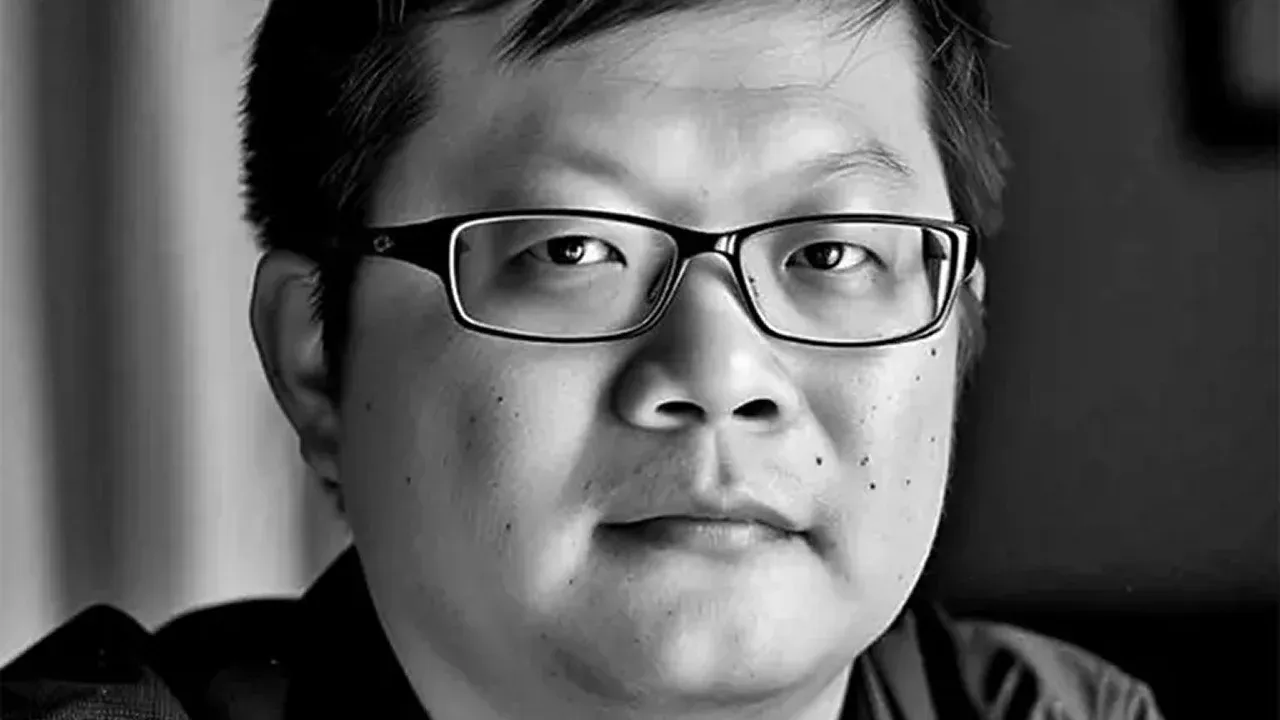

Concepto que proviene de un texto titulado "Hipnocracia: Trump, Musk y la nueva arquitectura de la realidad", cuya ficha bibliográfica lo atribuye a un filósofo de origen chino, llamado Jianwei Xun.

Fuera de este encuentro en Cannes, no existen registros de seminarios o citas que respalden “lo aclamado” de la obra o expertos que avalen que Xun sea un filósofo de moda o un referente en la materia, como ha descrito la prensa internacional, sino que más bien se trataría de un “filósofo artificial”.

Así lo confirmó la revista italiana L´Espresso. Este medio informó que el autor no existe y que la obra fue producto de un ejercicio social del ensayista y editor italiano Andrea Colamadeci, quien firma como traductor de la obra, pero en realidad es coautor del libro junto con dos lenguajes de inteligencia artificial: ChatGPT y Claude.

Un ejercicio similar al escándalo Sokal de 1996, cuando el físico Alan Sokal publicó un artículo falso en la revista Social Text, repleto de jerga científica y filosofía posmoderna. En este caso su intención era evidenciar la falta de rigor en algunas revistas académicas de humanidades.

La noticia que ha dado la vuelta al mundo, ha provocado tanto sorpresa como fascinación. Si bien las posturas son diversas, hay quienes prefieren no opinar dada la falta de información que valide la “aclamada obra” y más bien temen que esto sea parte de una estrategia de marketing. Por otro lado, también hay quienes consideran oportuno abrir el debate sobre las nuevas formas de generar contenidos.

Para la experta en ética de inteligencia artificial e integrante del Laboratorio de Inteligencia Artificial del Hub de Políticas Públicas de Fundación Encuentros del Futuro, Gabriela Arriagada, la hipnocracia no es sólo una obra, sino que es un experimento social y su existencia “nos obliga a revisar la noción de humanidad en un mundo donde lo artificial ya no es periférico, sino central en la producción de sentido”.

Sin embargo, este no es el primer texto creado por modelos de lenguaje de inteligencia artificial. Ejemplos de aquello son "1 the Road" (2018), un libro escrito por GPT-2, y "The Day a Computer Writes a Novel" (2015).

“Si las ideas del libro son pertinentes, ¿importa quién —o qué— las formula? Desde un punto de vista epistémico, el valor de una tesis no depende de su autor, sino de su capacidad de resistir el escrutinio crítico. Sin embargo, desde una perspectiva ética y cultural, el hecho de que una IA haya generado ideas profundamente críticas sobre el poder y la realidad pone en cuestión nuestras categorías de agencia intelectual”, añadió Arriagada.

De hecho, según comentan desde la academia, si esto fuera un artículo aceptado por una revista de prestigio, muy probablemente pasaría por el mismo conducto regular del plagio.

La urgencia de regular en materia de inteligencia artificial

La tecnología avanza a pasos agigantados y la regulación se queda atrás frente a su desarrollo. Para Cecilia Danesi, expositora de Congreso Futuro 2024 “más que nunca es necesario abrir el debate acerca de cómo la inteligencia artificial domina y manipula nuestros escenarios de la vida real, y creo que con esto queda reflejada la importancia de una regulación y que esa regulación efectivamente se cumpla”, sentenció.

En esta misma línea, Arriagada concluyó que este caso ilustra perfectamente cómo la IA no solo plantea riesgos técnicos, sino también culturales y epistémicos, y que regular es urgente, “si una IA puede escribir un libro filosófico que confunda al mundo intelectual, ¿qué impide que produzca desinformación sofisticada o manipule la opinión pública con autoridad simulada?”.

Conoce más sobre este tema en la charla “Desafiando el imperio de los algoritmos”, de la abogada e investigadora especializada en IA, género y derechos, Cecilia Danesi, quien nos acompañó en Congreso Futuro 2024 ¿IAhora qué hacemos?